Desde hace algún tiempo, utilizamos motores de traducción para proporcionar la mejor traducción posible para un texto determinado. Con la llegada de la inteligencia artificial, ahora podemos llevar ese servicio al siguiente nivel. Aunque la IA generativa no es ideal para la traducción automática, si le echamos un poco de polvo mágico de activos lingüísticos, podemos utilizarla para generar traducciones que respeten el estilo, el tono, la terminología y casi cualquier otra cosa que requiera un proyecto concreto. A continuación, vamos a profundizar en este tema con una lección de historia, una película de animación y la promesa de mejores traducciones.

Breve historia de los motores de traducción

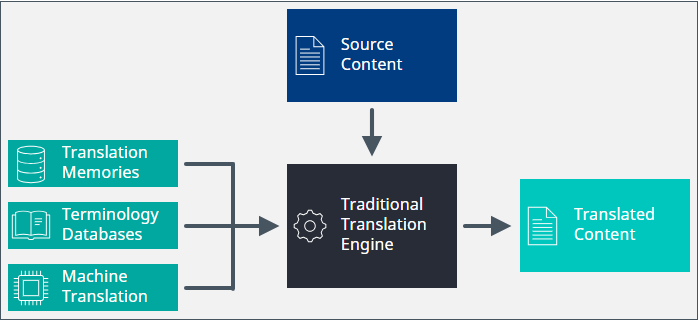

Durante la creación de nuestra nueva plataforma en la nube, decidimos dar un nuevo enfoque a la forma de organizar y utilizar los activos lingüísticos. Hasta entonces, cada activo lingüístico se trataba de forma aislada y existía una clara separación de funciones entre la memoria de traducción, la terminología y la traducción automática. Nuestro objetivo por aquel entonces era aunar estos recursos para crear un servicio sinérgico que ofreciera la mejor correspondencia posible a partir de toda la información disponible. Atrás quedaron los días en los que se aplicaba una memoria de traducción, se eliminaba cualquier texto sin traducir con la traducción automática y se proporcionaba terminología a los traductores cuando editaban el texto traducido. En su lugar, nuestro objetivo era aprovechar al máximo la eficacia de los recursos para crear la «mejor coincidencia posible». Así nació el motor de traducción.

Algunos de vosotros habréis visto la película de Aardman Animations titulada «Chicken Run: Evasión en la granja». En ella aparecía una máquina espantosa que convertía a las gallinas en tartas. Nunca se explicaba cómo las gallinas se convertían en pasteles. Era una máquina misteriosa y siniestra, pero sin duda un triunfo de la ingeniería. La Sra. Tweedy acuñó la frase «se mete una gallina y sale un pastel». ¿Pero qué tiene que ver esto con la traducción, os preguntaréis? Bueno, yo siempre he pensado que un motor de traducción es una máquina igual de misteriosa (aunque espero que no tan espantosa ni siniestra). En lugar de gallinas, lo alimentamos con texto, y en lugar de pasteles, obtenemos traducciones. «Se mete un texto y sale una traducción». No hace falta que sepamos cómo funciona, pero podemos estar seguros de que exprimimos todos los activos lingüísticos para obtener toda la información posible y de que el resultado es la mejor traducción posible. El siguiente diagrama muestra este planteamiento de «máquina misteriosa».

Algunos de los «trucos» que utilizamos son exactamente los que cabría esperar de un planteamiento así. Incluyen algunas tecnologías tradicionales de IA, entre otras:

- Coincidencia de fragmentos

- Modificación de coincidencias parciales

- Asistencia a la traducción automática con la terminología aplicable

Podría parecer que todo esto está muy bien. Es una buena idea. Está bien ejecutada. Nos damos apretones de manos y palmadas en la espalda. Entonces llega 2023 y dice: «¿Sabéis qué, chicos? ¡Ha llegado la IA!» Los representantes de la revolución de la IA han sido esos encantadores modelos generativos de chat a los que podemos pedir que escriban poesía, creen una nota de prensa o escriban un nuevo encabezado pegadizo para LinkedIn. OpenAI parecía ir a la cabeza, pero el resto no tardaron en empezar a ganarle terreno. Google, AWS, Meta y muchos más ya han puesto sus cartas sobre la mesa. Y podemos estar seguros de que vendrán muchos más; ya se escuchan los cascos de los caballos. La IA ha llegado para quedarse, así que, ¿qué vamos a hacer?

Es hora de actualizarse

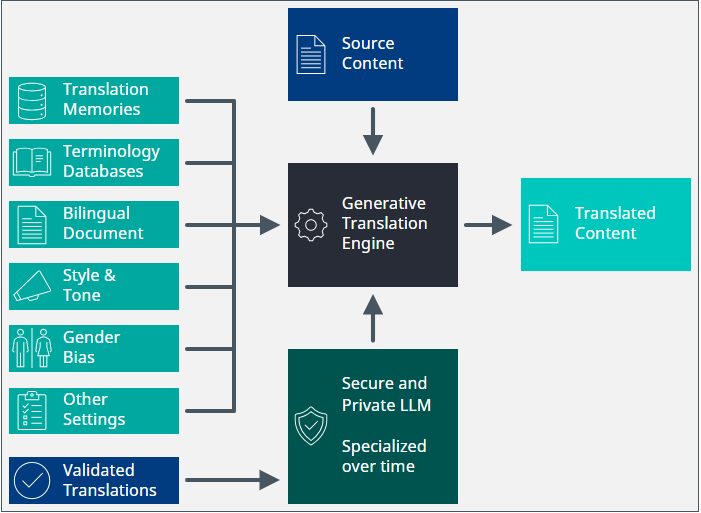

El avance de la IA nos ha brindado la oportunidad de poner a punto y potenciar nuestros motores de traducción. Si antes estábamos casi al límite de lo que podíamos exprimir de esos activos lingüísticos, ahora podemos hacer mucho más. Todos estos chatbots utilizan prácticamente la misma tecnología. Se analizan y procesan enormes cantidades de datos lingüísticos para crear algo conocido como LLM. [Nota al margen para los fanáticos de la lingüística. LLM no es un acrónimo, sino simplemente una sigla. Los acrónimos son un tipo de sigla que se pronuncia como una sola palabra, por ejemplo, OTAN, ONU, taser y NASA. Las siglas, por lo general, se pronuncian como letras individuales, por ejemplo, ADN, BCE, LCD y FBI. MPEG y JPEG son solo excepciones]. Volviendo al LLM, algunos diréis «¿qué es eso?». Pues bien, son las siglas en inglés de «gran modelo lingüístico»y, en nuestro sector, esa palabra del final es muy, MUY, interesante. Estos LLM permitirán a nuestros motores de traducción liberarse de las cadenas y dar rienda suelta a nuevas y potentes funcionalidades que podremos integrar en el núcleo de nuestra oferta de tecnología de traducción. Entre las funciones en las que puede ayudar un LLM se incluyen:

- Traducir un texto de un idioma a otro tras haber recibido información contextual y orientación.

- Poseditar traducciones creadas por la traducción automática neuronal.

- Evaluar la calidad del texto traducido y sugerir mejoras.

- Reescribir el texto de origen para que siga el estilo y la terminología de la empresa.

La corrección de traducciones automáticas o humanas no tardará en llegar, pero ahora mismo estamos centrando nuestros esfuerzos en el primer punto de esta lista. Ya hemos lanzado la aplicación OpenAI Translator, que se puede utilizar en Trados Studio. Esta aplicación utiliza un LLM para transformar, optimizar, analizar y sugerir traducciones alternativas del texto de los documentos; además, admite indicaciones por parte de los usuarios. No voy a profundizar demasiado aquí, pero merece la pena echar un vistazo a la página wiki de RWS Community para entender cómo los usuarios pueden modificar sus indicaciones para obtener diferentes estilos, tonos y longitudes. Sin embargo, lo que no tiene es acceso a todos esos preciosos activos lingüísticos que contiene un motor de traducción. Ese es el ingrediente secreto.

Author

David Pooley

Responsable de productos sénior

David es responsable de productos sénior en RWS, donde contribuye con más de dos décadas de experiencia en el desarrollo de tecnologías lingüísticas y la gestión de productos.

Su andadura en RWS comenzó en 1997, cuando se incorporó a SDL como desarrollador de software para trabajar en una de las primeras herramientas de memoria de traducción y estudiar las posibilidades de crear nuevas aplicaciones de tecnología lingüística. A lo largo de su trayectoria ha desempeñado diversas funciones y actualmente es responsable de las ofertas de Language Cloud y TMS. En el caso de Trados Enterprise, se especializa en costes, preparación de presupuestos, calidad, seguridad, la API abierta y el uso de la IA.

David ha contribuido en el pasado a estándares de localización como el formato Translation Memory eXchange (TMX) y SRX, y sigue siendo un apasionado de la tecnología lingüística.