Décollage immédiat : comment l'IA va booster les moteurs de traduction

Depuis un certain temps déjà, nous utilisons des moteurs de traduction pour obtenir la meilleure traduction possible pour un texte donné. Avec l'avènement de l'intelligence artificielle, nous pouvons désormais perfectionner ce service. Bien que l'IA générative ne soit pas parfaitement adaptée à la traduction automatique, l'intégration de ressources linguistiques nous permet de l'utiliser pour générer des traductions qui respectent la terminologie, le ton et le style requis pour un projet spécifique, ainsi que toute autre instruction associée. Examinons tout ceci plus en détail ci-dessous avec une leçon d'histoire, un film d'animation et la promesse de meilleures traductions à venir.

Bref historique des moteurs de traduction

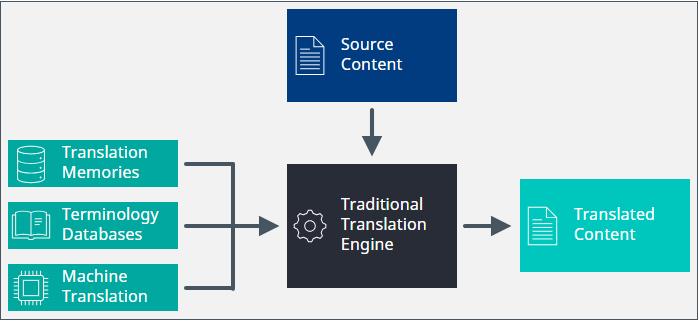

Lors de la création de notre nouvelle plateforme cloud, nous avons décidé d'adopter une nouvelle approche de l'organisation et de l'utilisation des ressources linguistiques. Jusqu'à présent, chaque ressource linguistique était traitée de manière isolée et les tâches liées aux mémoires de traduction, à la terminologie et à la traduction automatique étaient clairement séparées. À l'époque, notre objectif était de rassembler ces ressources afin de créer un service synergique qui fournirait la meilleure correspondance possible après analyse des informations à disposition. Nous ne voulions plus avoir à appliquer une mémoire de traduction, à traduire un texte à l'aide de la traduction automatique ou à fournir aux traducteurs une terminologie lorsqu'ils modifiaient du texte traduit. Au lieu de cela, notre objectif était de pouvoir optimiser l'efficacité des ressources afin de créer la « meilleure correspondance possible ». C'est ainsi qu'est né le moteur de traduction.

Certains d'entre vous ont peut-être vu le film Chicken Run du studio d'animation Aardman. On y voyait une terrible machine capable de transformer des poules en tourtes. Le mécanisme de transformation des poules en tourtes n'a jamais été montré ou détaillé à l'écran. Mystérieuse et inquiétante, cette machine était sans aucun doute un chef-d'œuvre d'ingénierie. On y entendait Mme Tweedy dire : « D'un côté, il entre une poule, de l'autre, il ressort une tourte ». Vous vous demandez quel est le rapport avec la traduction ? J'ai toujours pensé qu'un moteur de traduction était une machine tout aussi mystérieuse (et, espérons-le, moins macabre ou inquiétante). Au lieu des poules, on y intègre du texte, et au lieu des tourtes, on obtient des traductions. « D'un côté, il entre du texte, de l'autre, il ressort des traductions. » Vous n'auriez pas besoin de savoir comment la machine fonctionne, mais vous auriez l'assurance que les ressources linguistiques seraient exploitées pour chaque information que nous pourrions utiliser et que la traduction produite serait la meilleure possible. Le schéma ci-dessous illustre cette approche de « machine mystérieuse ».

Certaines des « astuces » que nous utilisons sont exactement ce que vous attendez d'une telle approche. Elles incluent certaines technologies d'IA traditionnelles, notamment les suivantes :

- Correspondance de fragments

- Réparation des correspondances partielles

- Traduction automatique avec la terminologie pertinente

Parfait, pensez-vous. Bonne idée. Bien joué. Tout le monde se congratule en se serrant la main et en se donnant de grandes tapes dans le dos. C'était sans compter sur l'année 2023 qui est venue tout chambouler avec l'IA. La révolution de l'IA a vu l'émergence des spokesbots, ces adorables modèles de chat génératifs à qui nous pouvons demander de rédiger des poèmes, un communiqué de presse ou un nouveau titre LinkedIn accrocheur. OpenAI semblait avoir coupé l'herbe sous le pied de tout le monde, mais d'autres ont suivi. Google, AWS, Meta et bien d'autres se sont déjà lancés dans la course. Mais de nouveaux concurrents ne sont pas loin, à l'affût. L'IA est là pour durer, alors qu'allons-nous faire ?

Il est temps d'évoluer

L'essor de l'IA nous a permis d'optimiser et de booster nos moteurs de traduction. Alors que nous avions presque atteint la limite de ce que nous pouvions tirer de ces ressources linguistiques, nous pouvons désormais faire bien plus. Ces chatbots utilisent à peu près tous la même technologie. D'énormes quantités de données linguistiques sont analysées et traitées pour créer ce que l'on appelle un LLM. [Remarque pour les amateurs de linguistique : LLM n'est pas un acronyme, mais un sigle. Les acronymes se prononcent comme un mot (OTAN, SCUBA, TASER et YOLO, par exemple). Les sigles se prononcent lettre par lettre (ADN, OMG, TBD et FAQ, par exemple). MPEG et JPEG sont des cas particuliers !] Revenons au LLM. Certains d'entre vous se demandent peut-être de quoi il s'agit. Ce terme signifie Large Language Model (grand modèle linguistique) et, dans notre secteur, ce dernier mot est très, TRÈS, intéressant. Ces LLM permettront à nos moteurs de traduction de se libérer de leurs chaînes et de proposer de nouvelles fonctions performantes que nous pouvons intégrer directement dans nos technologies de traduction. Un LLM vous permet :

- de traduire un texte d'une langue à une autre grâce aux informations contextuelles et aux conseils reçus ,

- de post-éditer des traductions créées à l'aide de la traduction automatique neuronale ;

- d'évaluer la qualité d'un texte traduit et de suggérer des améliorations ;

- de réécrire un texte source pour respecter le style et la terminologie de l'entreprise.

Il sera bientôt possible de corriger des traductions automatiques ou humaines, mais nous concentrons actuellement nos efforts sur le premier point de cette liste. Nous avons déjà lancé une application OpenAI Translator que vous pouvez utiliser dans Trados Studio. Elle utilise un LLM pour transformer, optimiser, analyser et suggérer des traductions alternatives pour les textes des documents. Elle prend également en charge des invites. Je ne vais pas trop entrer dans les détails, mais n'hésitez pas à consulter la page Wiki de RWS Community pour comprendre comment vous pouvez manipuler l'invite utilisée pour obtenir différents styles, tons et longueurs. Cependant, elle n'a pas accès à toutes les précieuses ressources linguistiques qu'offre un moteur de traduction. C'est l'ingrédient secret.

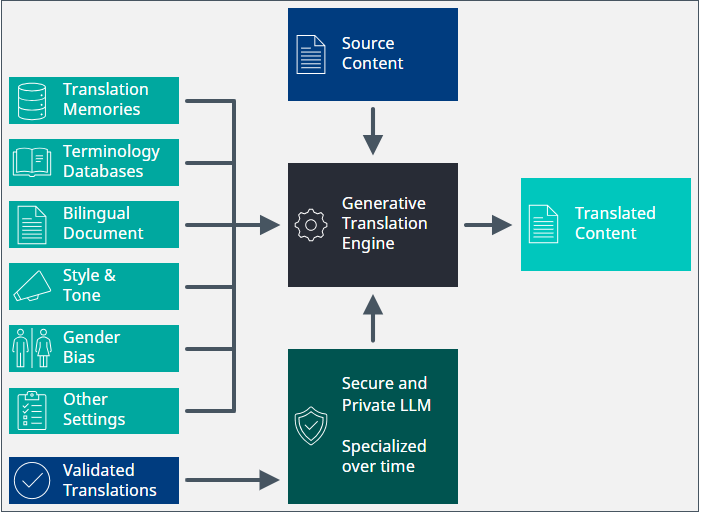

Grâce à l'IA, nos moteurs de traduction peuvent désormais produire de meilleures traductions. Pour traduire une phrase d'une langue à une autre, nous pouvons intégrer des informations au LLM, notamment les suivantes :

- Comment d'autres segments du même document ont été traduits.

- Comment des segments similaires ont été traduits par le passé (réutilisation de la technologie de correspondance partielle).

- Quels termes ont été identifiés dans le texte source et comment ils doivent être traduits.

- Le style de traduction requis (formel, informel, amical, professionnel, etc.).

- D'autres paramètres (longueur maximale ou langage non genré, par exemple).

Avec toutes ces informations à disposition, le LLM peut nous offrir exactement le résultat recherché. En outre, compte tenu du processus type d'un projet de traduction, nous pouvons « apprendre des choses » au LLM pour l'améliorer. En évaluant les traductions finales vérifiées, le modèle apprendra et fera de meilleures suggestions au fil du temps. Fantastique. Nous transmettons votre contenu à un LLM accessible au public pour obtenir en retour des traductions de haute qualité. Satisfait(e) ? Non ? Le fait qu'il soit « accessible au public » vous inquiète ? Ne craignez rien. Je suis sûr(e) que les membres des entreprises que j'ai mentionnées précédemment ne divulgueront pas votre propriété intellectuelle sur le Web. Vous n'êtes toujours pas convaincu(e) ? Et si nous vous proposions tout cela dans un LLM sécurisé et hébergé en privé ? Vous aurez ainsi l'assurance que vos données ne tomberont pas entre de mauvaises mains. Le schéma ci-dessous présente notre nouveau moteur de traduction. Aucune poule ne sera blessée.

Déploiement

Notre mise en œuvre initiale prend la forme d'une nouvelle tâche qui peut être incluse dans un processus personnalisé pour les clients Trados ayant accès à notre puissant éditeur de processus. Les utilisateurs pourront ainsi découvrir en avance les possibilités qu'offre notre nouvelle approche. À l'avenir, nous l'ajouterons aux fonctionnalités de base pour que tout le monde puisse y accéder. Suivez les dernières actualités via notre communauté et nos réseaux sociaux.